NVIDIA’nın yeni açık kaynaklı yapay zeka modeli Nemotron-3 Super, 120B parametresi ve Blackwell optimizasyonuyla DeepSeek ve GPT-OSS’i geride bırakarak liderliğe yükseliyor.

NVIDIA, sadece donanım tarafında değil, yazılım ve yapay zeka modelleri konusunda da sektörün mutlak hakimi olma yolunda dev bir adım daha atıyor. Şirketin en yeni açık kaynaklı yapay zeka modeli olan Nemotron-3 Super, yayınlanan son performans verilerine göre açık kaynak dünyasının zirvesine yerleşiyor.

120 milyar parametreli bu devasa model, özellikle kurumsal iş akışlarını ve karmaşık mantık yürütme süreçlerini test eden EnterpriseOps Gym gibi zorlu platformlarda DeepSeek ve GPT-OSS gibi güçlü rakiplerini geride bırakıyor. NVIDIA’nın Blackwell GPU mimarisi için optimize edilen bu model, yüksek işlem hızı ve 1 milyon tokenlik devasa bağlam penceresiyle yapay zeka ajanları döneminde yeni bir standart belirliyor.

Hibrit Mimari ile Maksimum Verimlilik: Nemotron-3 Super Neler Sunuyor?

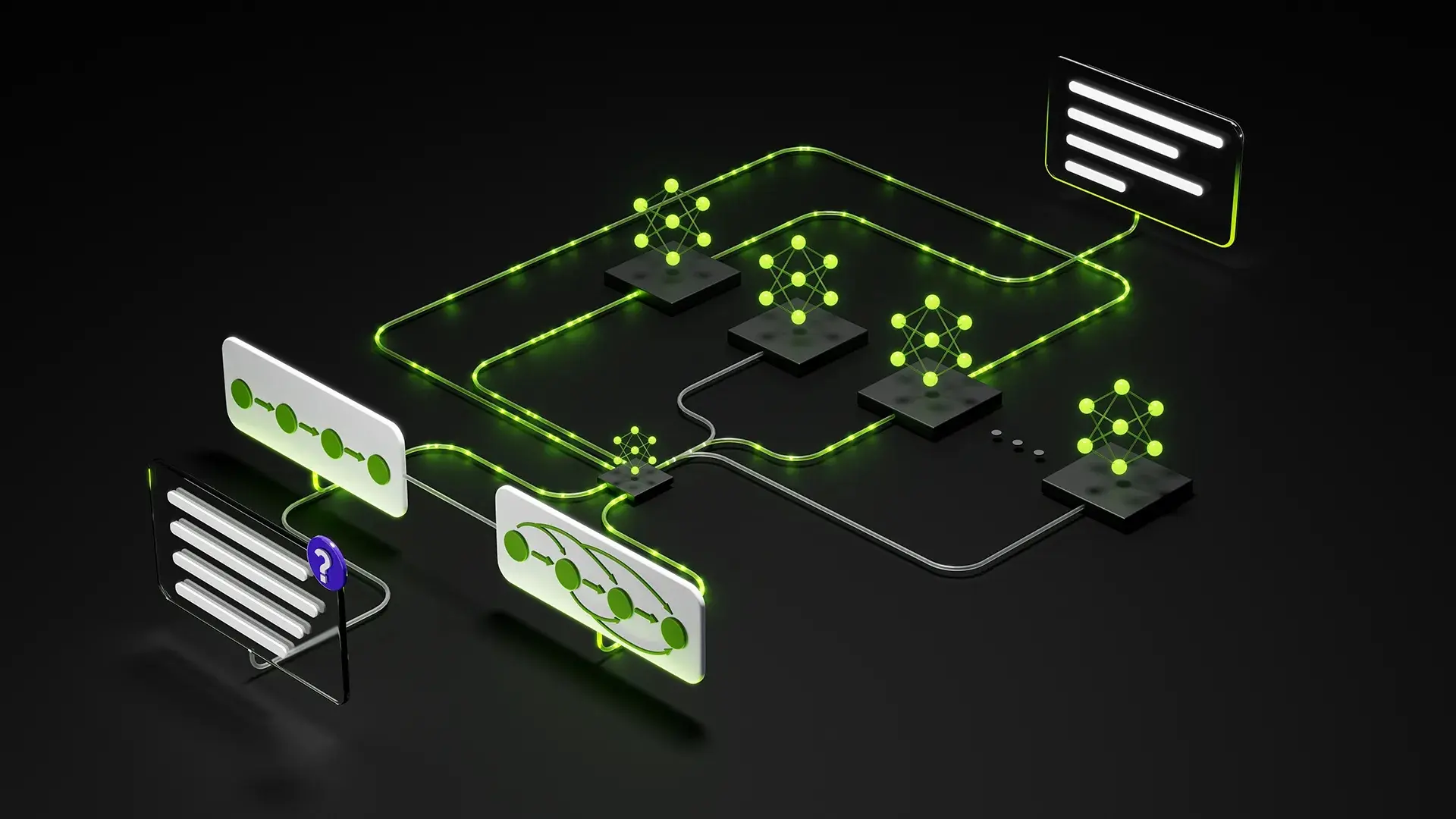

NVIDIA Nemotron-3 Super, teknik altyapısında barındırdığı yenilikçi Hybrid Mamba-Transformer MoE (Mixture-of-Experts) mimarisiyle dikkat çekiyor. Toplamda 120 milyar parametreye sahip olan model, işlem sırasında sadece 12 milyar aktif parametreyi kullanarak muazzam bir enerji ve işlem verimliliği sağlıyor. Bu “uzmanların karışımı” yaklaşımı, modelin her bir kelimeyi üretirken sadece ilgili bölümlerini çalıştırmasına imkan tanıyor.

Modelin en büyük kozlarından biri de NVIDIA’nın yeni nesil Blackwell (B200) ekran kartları için geliştirdiği NVFP4 (4-bit kayan nokta) formatını yerel olarak desteklemesi oluyor.

Bu teknoloji sayesinde bellek ihtiyacı ciddi oranda azalırken, işlem hızı önceki nesillere göre 5 kata kadar artıyor. 25 trilyon tokenlik devasa bir veri setiyle eğitilen Nemotron-3 Super, karmaşık kodlama görevlerinden siber güvenlik analizlerine kadar çok geniş bir yelpazede yüksek doğruluk oranı sergiliyor.

Rakiplerle Büyük Yarış: DeepSeek ve GPT-OSS Geride Kaldı

Açık kaynaklı yapay zeka pazarında rekabet hiç olmadığı kadar kızışıyor. Özellikle Çin merkezli DeepSeek’in V3.2 sürümü ve açık kaynak topluluğunun gözdesi GPT-OSS 120B, uzun süredir liderlik koltuğunu zorluyordu. Ancak EnterpriseOps Gym benchmark testlerinde Nemotron-3 Super, 27.3 puan alarak tüm rakiplerini alt sıralara itiyor.

Bu noktada objektif bir bakış açısıyla rakiplerin durumuna da bakmak gerekiyor. Meta’nın Llama 4 serisi ve Google’ın Gemma 3 modelleri, genel kullanım ve sohbet yetenekleri konusunda hala çok güçlü birer alternatif konumunda bulunuyor.

Özellikle Llama 4, geniş topluluk desteği ve esnek lisans yapısıyla hala birçok geliştiricinin ilk tercihi olmaya devam ediyor. Ancak konu “yapay zeka ajanları” (AI agents) ve kurumsal araç kullanımı olduğunda, NVIDIA’nın modelinin sunduğu araç çağırma (tool calling) yeteneği ve hata payının düşüklüğü, onu profesyonel kullanımda bir adım öne çıkarıyor.

1 Milyon Tokenlik Bağlam Penceresi ve Ajan Yetenekleri

Kurumsal dünyada yapay zeka modellerinin en büyük sorunu olan “hafıza” problemi, Nemotron-3 Super ile tarihe karışıyor. Model, sunduğu 1 milyon tokenlik bağlam penceresi sayesinde binlerce sayfalık dökümanı, geçmiş e-postaları ve karmaşık teknik klavuzları tek seferde hafızasında tutabiliyor.

Bu durum, özellikle uzun süreli projeleri takip eden özerk yapay zeka ajanları için kritik bir avantaj sağlıyor.

SWE-Bench Verified testlerinde %60,47 gibi yüksek bir başarı oranı yakalayan model, bir yazılım mühendisi gibi çalışarak gerçek dünyadaki GitHub sorunlarını çözebiliyor.

NVIDIA, bu hamlesiyle sadece bir GPU üreticisi olmadığını, donanım-yazılım bütünleşmesini (full-stack) en iyi başaran teknoloji devi olduğunu bir kez daha kanıtlıyor. Şirket, modellerini Hugging Face gibi platformlarda açıkça paylaşarak topluluğun gücünü de arkasına alıyor.

NVIDIA’nın Ekosistem Stratejisi Kazandırıyor

NVIDIA’nın bu başarısı tesadüf değil. Şirket; CUDA kütüphaneleri, TensorRT optimizasyon araçları ve şimdi de Nemotron modelleriyle kullanıcılarını kendi ekosistemine daha sıkı bağlıyor.

Nemotron-3 Super, sunduğu yüksek throughput (iş çıkarma kapasitesi) ve düşük gecikme süreleriyle özellikle veri merkezleri ve bulut sağlayıcıları için maliyetleri düşüren bir çözüm oluyor. Açık kaynak dünyasında Llama ve Mistral gibi devlerle olan bu yarış, nihayetinde son kullanıcıya daha zeki, daha hızlı ve daha güvenilir yapay zeka araçları olarak geri dönüyor.

Source link